Was ist der erste Schritt, um gefälschte Bewertungen zu erkennen

Um eine gefälschte Bewertung zu erkennen, ist es wichtig, nach Mustern in den positiven und negativen Bewertungen eines Produkts zu suchen.

Gefälschte positive Produktbewertungen neigen dazu, übermäßig enthusiastisch zu sein und spezifische Details zum Produkt oder zur Dienstleistung zu vermissen. Sie können auch in einem ähnlichen Stil geschrieben sein oder die gleichen Phrasen verwenden, was darauf hindeutet, dass sie von derselben Person oder Gruppe erstellt wurden.

Andererseits enthalten gefälschte negative Bewertungen oft übertriebene Behauptungen oder konzentrieren sich auf irrelevante Aspekte des Produkts oder der Dienstleistung. Achten Sie beim Online-Shopping und beim Durchsuchen des Produktbewertungsbereichs auf die Bewertungsverteilung.

Echte Bewertungen haben typischerweise eine Mischung aus positivem und negativem Kundenfeedback, die die unterschiedlichen Erfahrungen echter Kunden widerspiegelt. Wenn ein Produkt eine überwältigende Anzahl von Fünf-Sterne-Bewertungen mit wenigen oder keinen kritischen Kommentaren hat, kann dies ein Zeichen dafür sein, dass die Bewertungen nicht authentisch sind.

Ein weiteres Anzeichen für unechte Bewertungen ist ein plötzlicher Zustrom von Bewertungen innerhalb eines kurzen Zeitraums, insbesondere wenn das Produkt oder die Dienstleistung schon länger verfügbar ist. Dies könnte darauf hindeuten, dass jemand künstlich gefälschte Bewertungen kauft, um seine Bewertungen zu verbessern.

In diesem Artikel werden wir verschiedene Möglichkeiten untersuchen, um gefälschte Online-Bewertungen und -Ratings zu identifizieren und zu vermeiden, Opfer davon zu werden, damit Sie fundierte Entscheidungen auf der Grundlage echter Erfahrungen treffen können, die von echten Kunden geteilt werden.

Haben wirklich zwei Drittel aller Produkte eine zu gute Sternebewertung?

Es gibt immer mehr Artikel über gefälschte Bewertungen in der Presse und auf verschiedenen Online-Nachrichtenportalen. Dies bezieht sich auf verschiedene Branchen und deren Internetplattformen, von der Gastronomie über Reisen bis hin zu Suchmaschinen. Meistens geht es um Booking.com, Tripadvisor und Google. Und natürlich um Amazon.

Interessanterweise gibt es nur wenig Fachliteratur oder Studien zu diesem Thema. Jeder weiß, dass es „gefälschte“ oder gekaufte Bewertungen gibt; allerdings sind das Ausmaß und die Auswirkungen schlecht dokumentiert.

Die Vorreiter bei der Aufdeckung und Bekämpfung von „unechten Bewertungen“ sind in der Regel Verbraucherschutzorganisationen oder ähnliche Akteure. In Großbritannien ist dies „Which?“; in Deutschland beispielsweise die Stiftung Warentest.

Als Bewertungsexperten beschäftigen wir uns bei gominga natürlich auch intensiv mit dem Thema falscher Bewertungen, um unseren Kunden Rat und Unterstützung zu bieten.

Hier möchten wir auch auf das Kapitel „Produktbewertungen auf Amazon: Relevanz und Empfehlungen für Unternehmen“ im Buch „Amazon für Entscheider“ (Springer Verlag, April 2020) verweisen.

In den folgenden Abschnitten haben wir einen aktuellen Artikel der Stiftung Warentest zum Anlass genommen, das Thema „gefälschte Bewertungen“ und das Verfahren zur Identifizierung gefälschter Nutzerbewertungen zu untersuchen. Dazu haben wir den Analysewerkzeuganbieter ReviewMeta analog zur Bewertung der Stiftung Warentest verwendet und eine zusätzliche Vergleichsauswertung mit weiteren Bewertungsdaten durchgeführt.

Zusätzlich zu unseren Erkenntnissen stellen wir auch weitere Links zum Thema bereit, einschließlich aktueller Studien von „Which?“ aus Großbritannien und der Stiftung Warentest.

Seit mehreren Jahren werden nationale und internationale Studien durchgeführt, um den Einfluss von Bewertungen auf Verbraucher nachzuweisen. Auch wir haben den Wert von Kundenbewertungen umfassend erklärt.

Oft wird ein Zusammenhang zwischen Bewertungen, Preis und Verkauf nachgewiesen. Daher ist es bis zu einem gewissen Grad verständlich, dass es Versuche gibt, das Geschäft durch Manipulation von Bewertungen positiv zu beeinflussen.

Unechte Bewertungen sind immer häufiger geworden, um Kunden anzulocken.

Gefälschte Bewertungen sind am effektivsten für weniger bekannte Marken, Produkte mit wenigen technischen Attributen und preisgünstige Artikel. Manipulatoren zielen auf Sternebewertungen, Bewertungsmenge, Bewertungsverteilung und hochwertige gefälschte Bewertungen ab. Während Plattformen strenge Regeln implementieren, hält die Manipulation durch verschiedene Mittel an, von Familie und Freunden bis hin zu einer professionellen Schattenindustrie, die Social-Media-Gruppen, Zahlungsdienste, Bots und Bewertungs-Hijacking nutzt. Der Bericht der Stiftung Warentest von 2020 beschrieb diese Praktiken detailliert, einschließlich des Kaufs von Bewertungen und deren Analyse mit ReviewMeta.

Wir nutzten den Bericht als Gelegenheit, die Methodik, das Verfahren und die Ergebnisse genau zu untersuchen, um sie mit einem anderen Datensatz zu vergleichen und die Analyse zu replizieren.

„Die Frage und das Ziel für uns war: Kann man gekaufte Bewertungen wirklich leicht identifizieren? Wie hoch ist der Prozentsatz gekaufter Bewertungen, und gibt es einen Unterschied zwischen Markenprodukten und „No Name“

Möglichkeiten, gefälschte Bewertungen zu erkennen

Wie kann man gekaufte Bewertungen erkennen? Was sind die Kriterien? Wie kann ein solcher Testprozess für große Datenmengen automatisiert werden?

Eine effektive Methode, um unseriöse Bewertungen zu erkennen, ist die Identifizierung von Mustern oder Ähnlichkeiten in mehreren Produktbewertungen.

Wenn Sie bemerken, dass viele Bewertungen ähnliche Sprache, Formulierungen oder bestimmte Schlüsselwörter verwenden, könnte dies ein Zeichen dafür sein, dass sie gefälscht sind.

Dies gilt besonders, wenn die Bewertungen innerhalb eines kurzen Zeitraums veröffentlicht wurden oder wenn sie übermäßig positiv oder negativ sind, ohne spezifische Details zu liefern. Achten Sie auch auf den Namen des Bewertungsschreibers. Unechte Bewertungen werden oft von Profilen mit generischen Namen wie John Smith oder Jane Doe geschrieben.

Ein weiteres Warnsignal ist ein plötzlicher Zustrom von 5-Sterne- oder 1-Stern-Bewertungen, insbesondere wenn sie erheblich vom allgemeinen Bewertungstrend abweichen.

Echte Bewertungen neigen zu einer ausgewogeneren Verteilung der Bewertungen. Zahlreiche ähnliche Bewertungen könnten ebenfalls gefälscht sein.

Seien Sie außerdem vorsichtig bei Bewertungen, in denen erwähnt wird, dass der Verfasser ein kostenloses Produkt im Austausch für Feedback erhalten hat. Während einige Unternehmen Anreize für ehrliche Bewertungen bieten, könnte eine ungewöhnlich hohe Anzahl solcher Erwähnungen ein Zeichen für gefälschte Bewertungen sein.

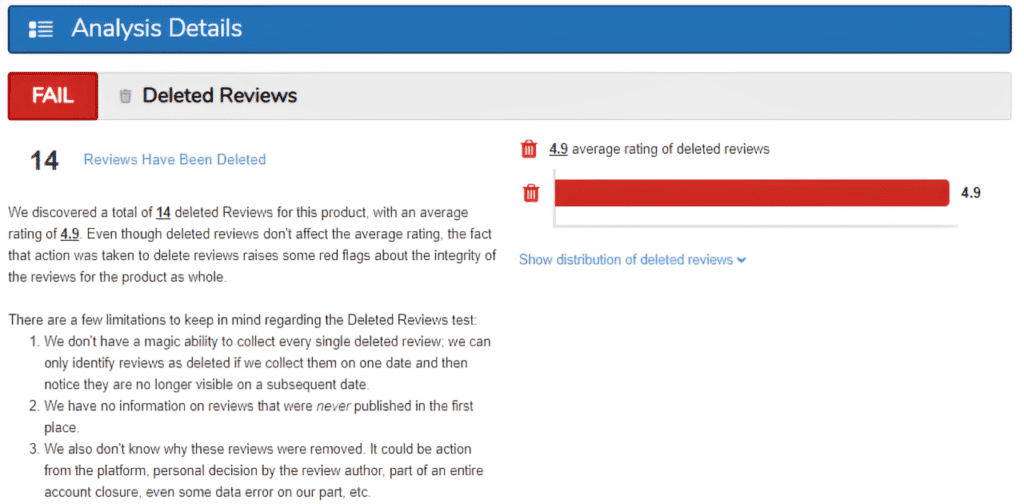

ReviewMeta ist eines der bekanntesten Tools auf dem Markt zur Identifizierung verdächtiger Bewertungen auf Amazon. Das Unternehmen sammelt zunächst Bewertungsdaten von den verschiedenen Amazon-Länderplattformen und unterzieht sie dann einer Authentizitätsprüfung.

Zum Beispiel gibt es derzeit 5,3 Millionen geprüfte Produkte auf amazon.com und fast 650.000 Produkte auf amazon.de

Dies bedeutet natürlich, dass es sich um eine statische Prüfung handelt und nicht immer alle aktuellen Daten abgefragt werden können. Zudem umfasst die sehr große Datenmenge nicht alle Produkte und deren Bewertungen.

ReviewMeta wertet meist die Top 100 Produkte verschiedener Kategorien aus. Diese Topseller-Listen enthalten dann – mal mehr, mal weniger – eine Mischung aus Produkten bekannter Markenhersteller und günstiger No-Name-Produzenten.

Das Tool ist kostenlos, sodass jeder einzelne Produkte abfragen und entweder direkt bei ReviewMeta oder über ein Browser-Plugin auf gefälschtes Produktfeedback prüfen kann. Abschließend sei erwähnt, dass ReviewMeta nicht von „unechten Bewertungen“ spricht; vielmehr heißt es: „ReviewMeta analysiert Amazon-Produktfeedback und filtert Bewertungen heraus, die unser Algorithmus als möglicherweise unnatürlich erkennt.“

„ReviewMeta selbst spricht nicht von „gefälschten Bewertungen“, sondern vielmehr: „ReviewMeta analysiert Amazon-Produktbewertungen und filtert Bewertungen heraus, die unser Algorithmus als unnatürlich einstuft.“

Was hat gominga untersucht?

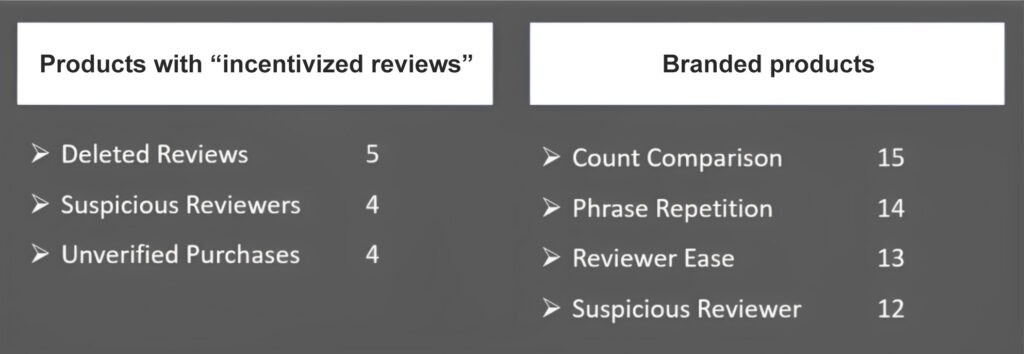

Wir haben das Tool von ReviewMeta verwendet, um zwei verschiedene Bewertungsdatensätze zu analysieren und zu vergleichen. Die erste Testgruppe umfasst 45 Produkte, bei denen wir von gekauften oder „angeregten“ Bewertungen wissen.

Die zweite Testgruppe umfasst 110 Produkte von Markenherstellern ohne gekaufte oder „angeregte“ Bewertungen. Alles gut gepflegte Sortimente mit durchgängig organisch generierten Bewertungen und aktivem Kundensupport, der auf negative Bewertungen reagiert und Fragen beantwortet.

Unsere Frage war also:

- Erkennt ReviewMeta gekaufte Bewertungen?

- Wie viele Bewertungen markiert ReviewMeta als „unnatürlich“?

- Wie ändert sich der Sternwert, nachdem ReviewMeta „unnatürliche“ Bewertungen aussortiert hat?

Wir waren auch daran interessiert zu sehen, ob es einen Unterschied zwischen günstigen No-Name-Produkten (oft Handyhüllen, Zubehör, Kabel, Wasserflaschen usw.) und den Produkten von Markenherstellern gibt.

Die Berechnung des Sternwerts ist wichtig für die Analyse und die Ergebnisse. Sowohl ReviewMeta als auch wir können dies nur anhand des arithmetischen Mittels der Bewertungen berechnen. Amazon hingegen verwendet einen Algorithmus, der verschiedene unbekannte Faktoren berücksichtigt. Daher gibt es in der Regel eine erhebliche Diskrepanz zwischen dem auf Amazon angezeigten Sternwert und dem berechneten Wert.

Amazon erklärt die Berechnung des Sternwerts wie folgt:

„Diese Modelle berücksichtigen mehrere Faktoren, einschließlich zum Beispiel, wie aktuell die Bewertung ist oder ob es sich um einen verifizierten Kauf handelt. Sie verwenden mehrere Kriterien, um die Authentizität des Feedbacks zu bestimmen. Das System lernt und verbessert sich im Laufe der Zeit weiter. Wir berücksichtigen Kundenbewertungen, die nicht den Status „Verifizierter Kauf“ haben, nicht in der Gesamtsternbewertung von Produkten, es sei denn, der Kunde fügt weitere Details in Form von Text, Bildern oder Videos hinzu“.

Sowohl wir als auch ReviewMeta berücksichtigen in unseren Berechnungen nur Bewertungen mit Text. Obwohl verifizierte reine Bewertungen ohne Text in den Gesamtdurchschnitt einfließen, können diese derzeit extern weder von uns noch von ReviewMeta erfasst werden. Diese können nur durch Vergleich ermittelt werden, wenn das Produkt bereits erfasst wurde.

Diese Anpassung ist größtenteils auf die unterschiedlichen Berechnungen des auf Amazon angezeigten Sternwerts und des arithmetischen Mittels der Neuberechnung zurückzuführen.

Für die hier bewerteten Produkte wurden die wenigsten Bewertungen (im Vergleich zu den anderen Clustern) durch ReviewMetas Regeln vollständig aussortiert, d.h. hier erfolgte die kleinste Anpassung.

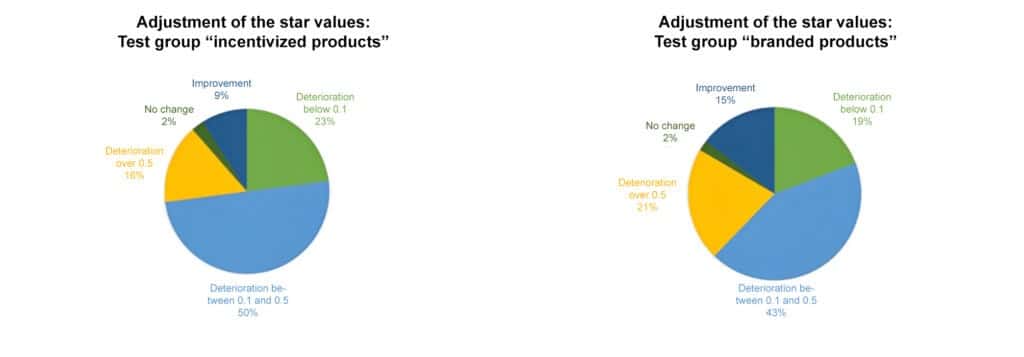

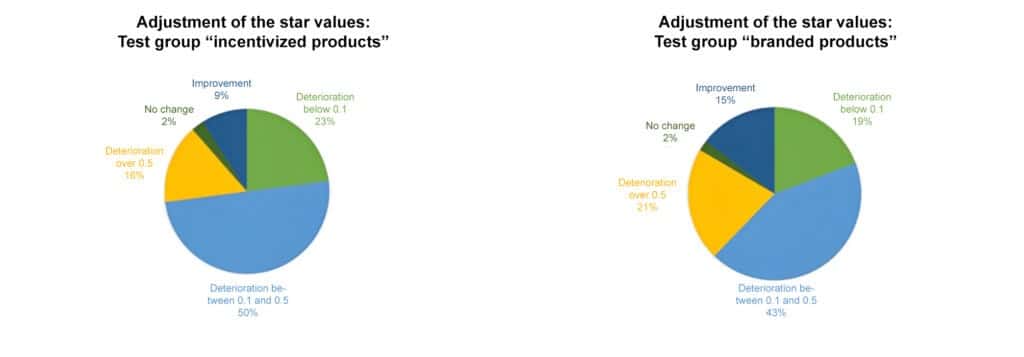

Bei 16% der Testgruppe mit „angeregten“ Bewertungen und 21% der Produkte der Markenhersteller lässt sich eine größere Änderung des Sternwerts von über 0,5 feststellen. Dies würde dann zu einer Änderung in der grafischen Darstellung des Sternwerts auf Amazon führen. Zum Beispiel werden dann 4 volle Sterne anstelle von 4 ½ angezeigt.

Bei 9% der Produkte mit „angeregten“ Bewertungen und 15% der Produkte von Markenherstellern führten die von ReviewMeta vorgenommenen Anpassungen sogar zu Verbesserungen der Bewertung. Mit anderen Worten, negative Bewertungen werden als „unnatürlich“ identifiziert.

Bei 2% der Produkte gibt es überhaupt keine Änderungen.

Anpassung der Anzahl der Produktbewertungen

Die Produkte in der Testgruppe mit „angeregten“ Bewertungen hatten vor der Analyse durch das ReviewMeta-Tool durchschnittlich 41 Bewertungen. Die Testgruppe der Markenprodukte hatte 423.

Es gibt viele Gründe dafür. Man könnte argumentieren, dass Markenprodukte von Natur aus bei den Verbrauchern bekannter sind und daher häufiger bewertet werden.

Darüber hinaus sind die Produktpräsentationen der Markenhersteller vermutlich besser gepflegt, und das Thema Bewertungen und Q&A wird aktiv gemanagt.

Andererseits haben die Produkte in der Testgruppe mit „angeregten“ Bewertungen deutlich weniger Bewertungen, was der ursprüngliche Grund für den Kauf von Bewertungen ist.

Das Aussortieren und Anpassen der quantitativen Anzahl von Bewertungen führt natürlich zur Möglichkeit, viele erfundene Bewertungen zu finden, was für die beiden Testgruppen durchweg ungleich ist.

In der Testgruppe mit „angeregten“ Bewertungen gab es bei 61% überhaupt keine Änderungen in der Anzahl der Bewertungen, d.h. 61% hatten überhaupt keine Beanstandungen oder diese führten nicht zum Ausschluss. Bei den Markenprodukten betraf dies nur 16%.

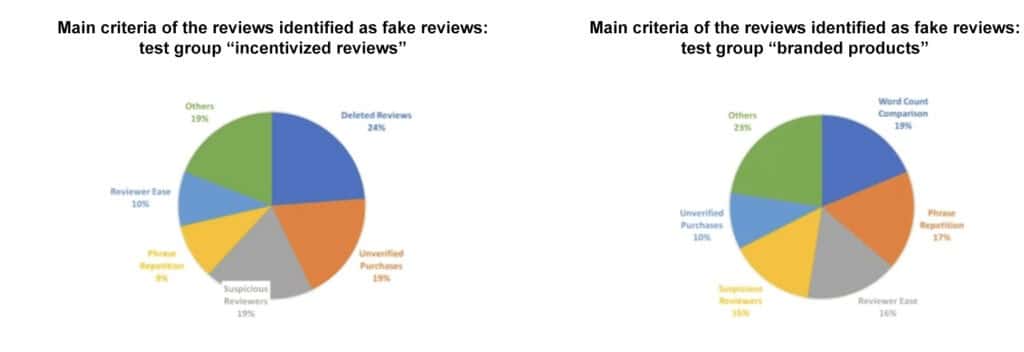

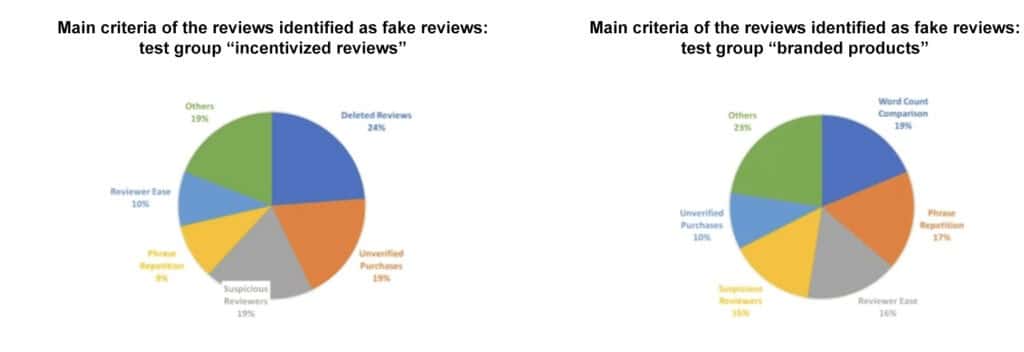

Die Hauptkriterien der als „unnatürlich“ identifizierten Bewertungen

Diese Anpassung ist größtenteils auf die unterschiedlichen Berechnungen des auf Amazon angezeigten Sternwerts und des arithmetischen Mittels der Neuberechnung zurückzuführen.

Für die hier bewerteten Produkte wurden die wenigsten Bewertungen (im Vergleich zu den anderen Clustern) vollständig aussortiert durch ReviewMetas Regeln, d.h. hier erfolgte die kleinste Anpassung.

Bei 16% der Testgruppe mit „angeregten“ Bewertungen und 21% der Produkte der Markenhersteller lässt sich eine größere Änderung des Sternwerts von über 0,5 feststellen.